¡Defiende los hechos!

Nuestra única agenda es publicar la verdad para que puedas ser un participante informado en la democracia.

Necesitamos tu ayuda.

Me gustaría contribuir

Este año, EE.UU. y más de 50 países tienen elecciones nacionales, y es probable que la IA generativa desempeñe un papel destacado. (Shutterstock)

SI TIENES POCO TIEMPO

-

PolitiFact identificó varios videos que usaron audio generado con inteligencia artificial para promover afirmaciones falsas, la mayoría están relacionados a la elección de 2024, en TikTok y YouTube.

-

La IA generativa hace que sea más sencillo y económico difundir desinformación. El audio generado por IA es particularmente barato de producir, en comparación con el video.

-

Para detectar el audio generado por IA, escucha si hay anomalías en la voz y verifica la información con fuentes confiables.

Si ves algo que te hace preguntar: ¿es cierto? Mándanoslo por WhatsApp y nuestro equipo lo investigará, (813) 260-7595.

Una publicación en redes sociales hizo lo que parecía ser un anuncio sorprendente sobre la carrera presidencial de 2024.

"Últimas noticias: Donald Trump ha declarado que se retira de la carrera presidencial", dice el narrador en un video en inglés en TikTok, el cual fue visto más de 161,000 veces antes de que TikTok lo removiera de su plataforma.

Por supuesto que Trump no se ha retirado de la carrera de 2024. El 12 de marzo, el aseguró suficientes delegados para obtener la nominación presidencial republicana.

Además de la afirmación falsa, el video tenía otro elemento distintivo: El audio parecía ser hecho con inteligencia artificial.

PolitiFact identificó varias cuentas en TikTok esparciendo narrativas falsas sobre las elecciones de 2024 y Trump a través de nuestra colaboración con TikTok para combatir contenido inauténtico, desinformativo o falso. (Lea más sobre nuestra colaboración con TikTok).

Sign up for PolitiFact texts

Videos en YouTube también hicieron afirmaciones similares. Estos videos, los cuales también parecían tener audio generado por IA, fueron compartidos en Facebook y X con menos participación.

La IA Generativa es un término amplio que describe cuando computadoras crean nuevo contenido, como texto, fotos, videos y audio, identificando patrones en datos existentes. Este año, los Estados Unidos y más de otros 50 países tienen elecciones nacionales, y es probable que la IA generativa juegue un papel destacado. En febrero en Indonesia, caricaturas generados por IA ayudaron a rehabilitar la imagen de un ex general militar que estaba relacionado a abusos de derechos humanos, quien ganó la elección presidencial en el país.

Avances recientes en la AI generativa han hecho más difícil determinar si el contenido en internet es real o falso. Hablamos con expertos sobre cómo esta tecnología está cambiando el panorama de la información y como saber si un audio fue generado por IA. A diferencia de los vídeos, no hay anormalidades visuales que puedan dar señales de manipulación.

Cuando contactamos a TikTok para una declaración, un vocero dijo, "Para aplicar nuestras políticas de desinformación dañina, detectamos el contenido engañoso y lo enviamos a nuestros colaboradores verificadores para una evaluación factual". Una vez alertados sobre el contenido señalado en esta historia, TikTok lo removió de su plataforma.

Análisis del audio generado por inteligencia artificial

Le pedimos a expertos en inteligencia artificial generativa que analizaran cinco videos en TikTok que hicieron afirmaciones falsas y engañosas en múltiples cuentas para determinar si habíamos acertado en que el audio había sido generado con IA.

Hafiz Malik, un profesor de ingeniería eléctrica y computación que estudia "deepfakes" en la Universidad de Michigan-Dearborn, dijo que sus herramientas de detección de IA clasificaron cuatro de los videos como "sintético", o audio generado por IA. El quinto fue señalado como de "baja confianza", lo cual Malik dice que significa que algunas partes fueron etiquetadas como "deepfake", pero otras no. Los videos "deepfake" son sofisticados, generados por computadora y dan la impresión que alguien está diciendo o haciendo algo, aun cuando esa persona no dijo o hizo eso.

Siwei Lyu, un profesor de informática e ingeniería de la Universidad de Buffalo que se especializa en análisis forense de medios digitales, dijo que sus algoritmos de detección de inteligencia artificial también determinaron que la mayoría de los cinco videos usaron audio generado por IA.

Videos en TikTok hacen afirmaciones falsas y escandalosas

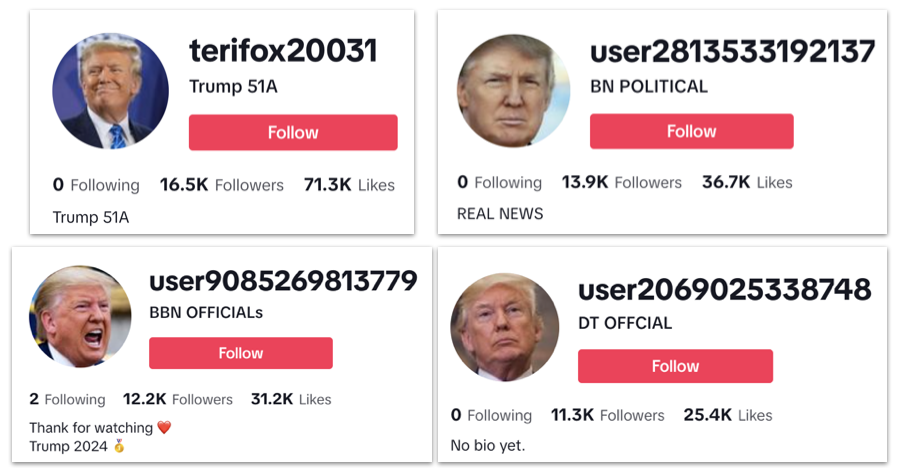

Trump fue el foco de estas cuentas en TikTok; varias de las cuentas utilizaron fotos del expresidente como sus fotos de perfil.

(Capturas de pantalla de TikTok)

Estas cuentas siguieron un esquema similar: titulares llamativos a menudo mostrados sobre fondos rojos; videos que contienen clips o fotos de figuras famosas, incluyendo a Trump y el juez de la Corte Suprema Clarence Thomas; y a un narrador oculto.

Algunos de los videos hicieron declaraciones falsas sobre el bienestar de personas de alto perfil — que Trump había tenido un ataque al corazón y que la secretaria de Justicia de Nueva York Letitia James fue hospitalizada por heridas de balas. James demandó a Trump en 2022 acusándolo de inflar fraudulentamente su valor neto; un juez dictó en febrero que Trump debe pagar una multa de $454 millones.

Otro video mostraba un texto que decía, "Juez de la Corte Suprema Clarence Thomas se une a otros jueces para remover al candidato de la carrera de 2024". Esto parece referirse engañosamente al caso de la Corte Suprema sobre la elegibilidad de Trump para estar en la boleta de votación, en el cual Thomas y otros jueces dictaron por unanimidad que los estados individuales no pueden suspender a candidatos presidenciales, incluyendo a Trump, de la boleta.

(Capturas de pantalla de TikTok)

Todas estas cuentas en TikTok fueron creadas en los últimos meses. La que parece más antigua tiene videos de noviembre de 2023; la más nueva comenzó a publicar contenido el 1 de marzo. Tres de las cuentas tenían nombres de usuarios designados por TikTok como "usuario" seguido por 13 números.

Estas cuentas publicaron colectivamente cientos de videos y obtuvieron miles de vistas y reacciones de me gusta y seguidores, antes de que TikTok removiera las cuentas y videos.

También encontramos videos en YouTube haciendo las mismas declaraciones falsas como los videos de TikTok. Estos videos imitaron el formato de los videos en TikTok: titulares sensacionalistas, fotos de Trump, y audio que suena generado por IA.

(Capturas de pantalla de YouTube)

La mayoría de los videos en YouTube fueron vistos cientos o miles de veces. Las dos cuentas de YouTube que publicaron los videos fueron creadas en 2021 y 2022. Estas cuentas acumularon decenas de miles de seguidores antes de que contactaramos a YouTube por una declaración y la compañía removiera las cuentas de la plataforma.

"Contenido involucrando prácticas engañosas que confunden y se aprovechan de la comunidad de YouTube no es permitido. Como tal, cancelamos los canales de On Point Juicy News and THE BREAK TIME por violar repetidamente nuestras politicas de spam, practicas engañosas y estafas", dijo Ivy Choi, una vocera de YouTube.

Antes de que YouTube eliminara los videos, estos fueron compartidos en otras plataformas de redes sociales, incluyendo Facebook y X, donde pocas personas le dieron me gusta o las vieron. (Lea más sobre nuestra colaboración con Meta, propietaria de Facebook e Instagram).

¿Cómo contribuye la IA generativa a la desinformación en internet?

Los expertos en desinformación afirman que las nuevas generaciones de IA generativa están facilitando la creación y difusión de contenidos engañosos en redes sociales. Además, crear audio generado por IA suele ser más barato que el video.

"Ahora, cualquiera con acceso a internet puede disponer del poder de miles de escritores, técnicos de audio y productores de video, de forma gratuita y con sólo pulsar un botón", afirma Jack Brewster, un editor en NewsGuard, una empresa que rastrea la desinformación en internet.

"En las manos adecuadas, ese poder puede utilizarse para el bien", dijo Brewster. "En las manos equivocadas, ese poder puede utilizarse para contaminar nuestro ecosistema de información, desestabilizar las democracias y socavar la confianza pública en las instituciones".

NewsGuard informó en septiembre de 2023 de que se estaba utilizando tecnología de voz de IA para difundir teorías conspirativas en masa a través de TikTok. NewsGuard reportó que "identificó una red de 17 cuentas de TikTok que utilizaban software de texto a voz de IA para generar videos que avanzaban afirmaciones falsas y sin fundamento, con cientos de millones de visualizaciones."

Un estudio de la Universidad de British Columbia de 2023 que utilizó datos de TikTok descubrió que la tecnología de conversión de texto a voz mediante IA simplificaba la creación de contenidos, motivando a los creadores de contenidos a producir más videos.

Los autores del estudio, Xiaoke Zhang y Mi Zhou, dijeron a PolitiFact que el aumento de la productividad significa que la IA generativa "puede explotarse deliberadamente para generar desinformación a bajo costo".

La tecnología también puede ayudar a los usuarios a ocultar su identidad, lo que puede "disminuir su sentido de la responsabilidad a la hora de garantizar la exactitud de la información", señalaron Zhang y Zhou.

TikTok exige a los usuarios que etiqueten los contenidos que contienen imágenes, videos o audio generados por IA "para ayudar a los espectadores a contextualizar el video y evitar la posible difusión de contenidos engañosos." Las directrices de la comunidad de TikTok prohíben el "contenido inexacto, engañoso o falso que pueda causar un daño significativo a las personas o a la sociedad".

Ningún video de TikTok que revisamos tenía esta etiqueta de IA generativa, aunque algunos incluían etiquetas para aprender más sobre las elecciones de EE.UU. Brewster dijo que NewsGuard también observó que muchos usuarios de TikTok se saltaban esta política sobre la identificación de contenidos generados por IA.

Las directrices de la comunidad de YouTube no permiten "contenido engañoso que genere riesgos graves de daño flagrante". YouTube exige la divulgación de la publicidad electoral que contenga "materiales alterados o generados digitalmente". La compañía dijo en diciembre que planea ampliar esta divulgación de IA generativa a otros contenidos.

Cómo detectar audio generado por IA

Los expertos dicen que las herramientas de detección de IA existentes son imperfectas. Añaden que, a medida que mejoran las herramientas de detección, también lo hace la tecnología de IA generativa.

El audio generado por IA carece de señales visuales que se observan en videos, como los movimientos de la boca que no están sincronizados con el audio o los rasgos físicos distorsionados.

Sin embargo, hay formas de identificar el audio generado por IA.

Malik, profesor de la Universidad de Michigan, dice que hay que prestar atención a las anomalías en el tono vocal, la articulación o el ritmo.

"(Las voces generadas por IA) carecen de emociones. Carecen de las subidas y bajadas de volumen que se producen normalmente al hablar", dijo Malik. "Son bastante monótonas".

Brewster también aconsejó que las "viejas tácticas" siguen siendo la mejor manera de evitar la desinformación generada por la IA. Por ejemplo:

-

Contrastar la información con la de otros sitios

-

Estar atento a los errores gramaticales y a las expresiones extrañas

-

Buscar los nombres de los autores para ver si han compartido información falsa en el pasado.

Una versión de este artículo fue escrito originalmente en inglés y traducido por Maria Briceño y Marta Campabadal.

Read a version of this article in English.

Lea más reportes de PolitiFact en Español aquí.

Debido a limitaciones técnicas, partes de nuestra página web aparecen en inglés. Estamos trabajando en mejorar la presentación.

Nuestras fuentes

Fuentes incluidas en el artículo en inglés.